BOMBA ATOMOWA: Rothschilds opatentował testy biometryczne Covid-19 w 2015 r. I 2017 r.

Silviu „Silview” Costinescu

Nie podlega dyskusji, ponieważ informacje pochodzą z oficjalnych rejestrów patentowych w Holandii i USA. Mamy całą dokumentację

AKTUALIZACJA: Reuters zajął się kontrolą szkód w tym artykule i opublikował oszczerstwo i oczernianie nas, udające „weryfikację faktów”.

Sprawdziliśmy tutaj fakty, fraza po frazie.

here.

Jak pokazaliśmy w poprzednich ekspozycjach, cała Covidiocracy to maskarada i symulacja długo przygotowywana przez Bank Światowy / MFW / The Rothschilds i ich lemingów, przy współpracy Rockefellera.

Nasze najnowsze odkrycia uzupełniają te poprzednie objawienia.

pierwsza rejestracja: Holandia, 2015

Source: Dutch Government patent regitry website

Informacje (kopia dosłowna):

Zapewniona jest metoda pozyskiwania i przesyłania danych biometrycznych (np. Parametrów życiowych) użytkownika, gdzie dane są analizowane w celu ustalenia, czy użytkownik cierpi na infekcję wirusową, taką jak COVID-19. Metoda polega na użyciu pulsoksymetru w celu uzyskania co najmniej wartości procentowej tętna i nasycenia tlenem krwi, która jest przesyłana bezprzewodowo do smartfona. Aby zapewnić dokładność danych, do pomiaru ruchu smartfona i / lub użytkownika używany jest akcelerometr w smartfonie. Po zebraniu dokładnych danych są one przesyłane do chmury (lub hosta), gdzie są one wykorzystywane (samodzielnie lub razem z innymi objawami życiowymi) w celu ustalenia, czy użytkownik cierpi na infekcję wirusową (lub może na nią cierpieć), takie jak COVID-19. W zależności od określonych wymagań, dane, ich zmiany i / lub ustalenie mogą być wykorzystane do ostrzeżenia personelu medycznego i podjęcia odpowiednich działań.

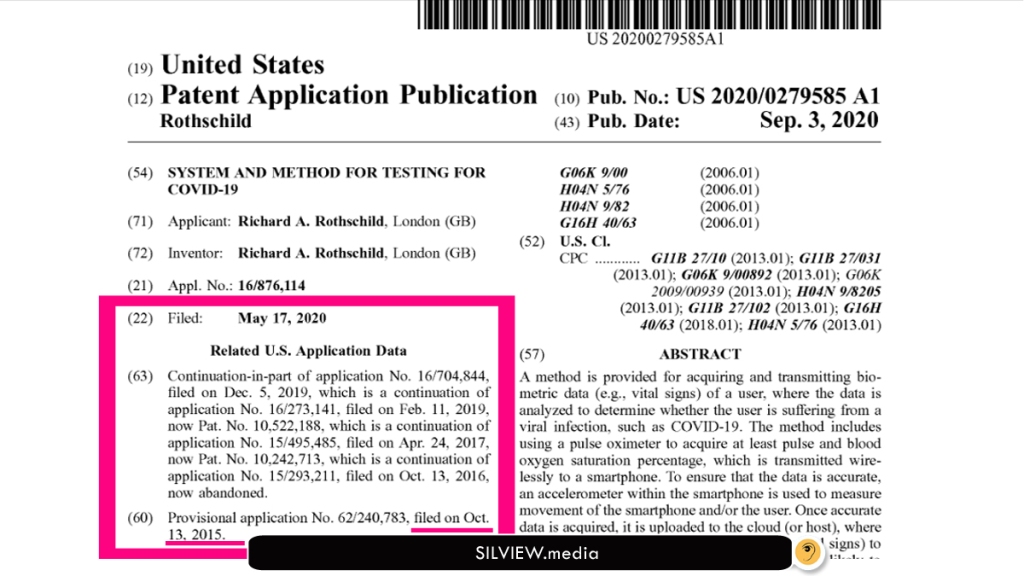

Druga rejestracja: USA, 2017

Szczegółowe informacje poniżej.

DOWNLOAD FROM GOOGLE PATENTS (PDF)

JEDEN KLUCZOWY SZCZEGÓŁY UDERZAJ MNIE NA TE REJESTRACJE:

Oba zostały złożone i zaktualizowane wiele lat temu, ale ZAPLANOWANO ich upublicznienie we wrześniu 2020 r.

To wystarczający dowód na to, że wiedzieli w 2015 roku, co wydarzy się we wrześniu 2020 roku!

REJESTRACJA TRZECIA: USA, 2017 (AKTUALIZACJA OD 2015 ROKU)

Zanim przedstawimy szczegóły techniczne patentu, zastanówmy się przez chwilę na Facebooku wynalazcy:

Informacje o patencie (kopia dosłowna):

Tytuł: System i metoda użycia, biometrii i wyświetlania danych biometrycznych Zgłoszenie patentowe Stanów Zjednoczonych 20170229149 Kod rodzaju: A1

Streszczenie: Zapewniono metodę przetwarzania i wyświetlania danych biometrycznych użytkownika, samodzielnie lub razem (w synchronizacji) z innymi danymi, takimi jak dane wideo użytkownika w czasie, gdy dane biometryczne zostały pozyskane. Metoda obejmuje przechowywanie danych biometrycznych w taki sposób, aby były powiązane z identyfikatorem i co najmniej jednym znacznikiem czasu (np. Godzina rozpoczęcia, częstotliwość próbkowania itp.) Oraz przechowywanie danych wideo tak, aby były powiązane z identyfikatorem i co najmniej co najmniej jeden znacznik czasu (np. godzina rozpoczęcia). Przechowując dane w ten sposób, dane biometryczne mogą być wyświetlane (w czasie rzeczywistym lub z opóźnieniem) w synchronizacji z danymi wideo, a dane biometryczne można przeszukiwać w celu zidentyfikowania co najmniej jednego zdarzenia biometrycznego. Wideo odpowiadające zdarzeniu biometrycznemu może być następnie wyświetlane, samodzielnie lub razem z co najmniej jedną biometrią użytkownika podczas zdarzenia biometrycznego.

Wynalazcy: Rothschild, Richard A. (Londyn, Wielka Brytania)

Macklin Dan (Stafford, Wielka Brytania)

Slomkowski, Robin S. (Eugene, OR, USA)

Harnischfeger, Taska (Eugene, Oregon, USA)

Numer aplikacji: 15/495485

Data publikacji: 08/10/2017

Data zgłoszenia: 24.04.2017 Eksportuj cytat: Kliknij, aby automatycznie wygenerować bibliografię

Mandatariusz:

Rothschild Richard A.

Macklin Dan

Słomkowski Robin S.

Harnischfeger Taska

Klasy międzynarodowe: G11B27 / 10; G06F19 / 00; G06K9 / 00; G11B27 / 031; H04N5 / 77

View Patent Images: Download PDF 20170229149

Odniesienia do patentów w USA:

20160035143 nie dotyczy 2016-02-04

20140316713 nie dotyczy 2014-10-23

20140214568 nie dotyczy 2014-07-31

20090051487 nie dotyczy 2009-02-26

20070189246 nie dotyczy 2007-08-16

Główny egzaminator: MESA, JOSE M Attorney, Agent lub firma: Fitzsimmons IP Law (Gardena, Kalifornia, USA)

Roszczenia: roszczenie to:

1. Sposób identyfikacji wideo odpowiadającego zdarzeniu biometrycznemu użytkownika, przy czym wspomniane wideo jest wyświetlane wraz z co najmniej jedną wartością biometryczną wspomnianego użytkownika podczas wspomnianego zdarzenia biometrycznego, obejmujący: odbieranie żądania rozpoczęcia sesji; wykorzystanie co najmniej jednego programu uruchomionego na urządzeniu mobilnym do przypisania numeru sesji i czasu rozpoczęcia wspomnianej sesji; odbieranie danych wideo z kamery, przy czym wspomniane dane wideo obejmują wideo co najmniej jednego ze wspomnianych użytkowników i otoczenia wspomnianego użytkownika w określonym przedziale czasu, przy czym wspomniany okres rozpoczyna się we wspomnianym czasie rozpoczęcia; odbieranie danych biometrycznych z czujnika, przy czym wspomniane dane biometryczne obejmują wiele wartości danych biometrycznych wspomnianego użytkownika we wspomnianym okresie; wykorzystanie co najmniej jednego programu do połączenia co najmniej wymienionego numeru sesji i wymienionego czasu rozpoczęcia z wymienionymi danymi wideo; wykorzystanie co najmniej jednego programu do połączenia co najmniej wspomnianego numeru sesji, wspomnianego czasu rozpoczęcia i częstotliwości próbkowania ze wspomnianymi danymi biometrycznymi, przy czym co najmniej wspomniany numer sesji jest używany do połączenia wspomnianych danych biometrycznych ze wspomnianymi danymi wideo i co najmniej wspomniana częstotliwość próbkowania a wspomniany czas rozpoczęcia jest używany do łączenia poszczególnych z wielu wartości z indywidualnymi czasami we wspomnianym okresie; odebranie wspomnianego zdarzenia biometrycznego, przy czym wspomniane zdarzenie biometryczne obejmuje jedno z wartości i zakresu wspomnianego zdarzenia biometrycznego; wykorzystanie co najmniej jednego programu do identyfikacji pierwszego z wielu wartości odpowiadających wymienionemu zdarzeniu biometrycznemu; wykorzystanie co najmniej jednego programu i co najmniej wymienionego czasu rozpoczęcia, wymienionej częstotliwości próbkowania i wymienionego okresu do zidentyfikowania pierwszego czasu w wymienionym okresie odpowiadającym wymienionemu pierwszemu ze wspomnianych wielu wartości; i wyświetlanie na wspomnianym urządzeniu mobilnym przynajmniej wspomnianych danych wideo podczas wspomnianego pierwszego razu wraz ze wspomnianym pierwszym z wielu wspomnianych wartości, przy czym wspomniany pierwszy raz jest używany do pokazania wspomnianej pierwszej z wielu wartości w synchronizacji z częścią wspomnianego wideo dane, które pokazują co najmniej jednego wspomnianego użytkownika i otoczenie wspomnianego użytkownika podczas wspomnianego zdarzenia biometrycznego.

2. Sposób według zastrzeżenia 1, w którym wspomniany etap odbierania danych biometrycznych z wspomnianego czujnika obejmuje ponadto odbieranie danych tętna z czujnika tętna.

3. Sposób według zastrzeżenia 1, w którym wspomniane etapy łączenia wspomnianego numeru sesji ze wspomnianymi danymi wideo i wspomnianymi danymi biometrycznymi obejmują ponadto łączenie numeru czynności zarówno ze wspomnianymi danymi wideo, jak i wspomnianymi danymi biometrycznymi, przy czym wspomniany numer czynności identyfikuje jedną z wielu czynności, wspomniana sesja obejmuje wspomnianych wiele czynności, a zarówno wspomniany numer sesji, jak i wspomniany numer czynności, są wykorzystywane do łączenia wspomnianych danych biometrycznych ze wspomnianymi danymi wideo.

4. Sposób według zastrzeżenia 1, w którym wspomniany etap przypisywania numeru sesji do wspomnianej sesji obejmuje ponadto łączenie opisu wspomnianej sesji ze wspomnianą sesją.

5. Sposób według zastrzeżenia 1, w którym wspomniane etapy odbierania danych wideo i danych biometrycznych obejmują ponadto odbieranie wspomnianych danych wideo i wspomnianych danych biometrycznych we wspomnianym okresie czasu.

6. Sposób według zastrzeżenia 1, w którym wspomniany etap odbierania danych wideo z kamery obejmuje ponadto odbieranie wspomnianych danych wideo ze wspomnianej kamery po wspomnianym okresie czasu.

7. Sposób według zastrzeżenia 6, obejmujący ponadto etap analizy wspomnianych danych wideo pod kątem identyfikatora identyfikującego wspomnianą sesję, przy czym wspomniany identyfikator jest używany przez wspomniany co najmniej jeden program do połączenia wspomnianego numeru sesji ze wspomnianymi danymi wideo.

8. Sposób według zastrzeżenia 1, w którym wspomniane etapy identyfikowania pierwszej ze wspomnianych wielu wartości odpowiadających wspomnianemu zdarzeniu biometrycznemu i identyfikowania pierwszej chwili odpowiadającej wspomnianemu pierwszemu ze wspomnianych wielu wartości obejmują ponadto identyfikację każdej ze wspomnianych wielu wartości. wartości odpowiadające wspomnianemu zdarzeniu biometrycznemu i identyfikujące każdorazowo odpowiadające wspomnianej każdej ze wspomnianych wielu wartości.

9. Sposób według zastrzeżenia 8, w którym wspomniany etap wyświetlania co najmniej wspomnianych danych wideo podczas wspomnianego pierwszego czasu obejmuje ponadto wyświetlanie co najmniej wspomnianych danych wideo podczas wspomnianego każdego czasu odpowiadającego wspomnianej każdej ze wspomnianych wielu wartości, przy czym wspomniany każdy czas jest stosowane do pokazania każdej ze wspomnianych wielu wartości w synchronizacji z częściami wspomnianych danych wideo, które pokazują co najmniej jednego wspomnianego użytkownika i otoczenie wspomnianego użytkownika podczas wspomnianego zdarzenia biometrycznego.

10. Sposób według zastrzeżenia 1, obejmujący ponadto etapy odbierania danych samorealizacji od wspomnianego użytkownika i łączenie co najmniej wspomnianego numeru sesji i co najmniej jednego czasu ze wspomnianymi danymi samorealizacji, przy czym wspomniane dane samorealizacji wskazują, w jaki sposób wspomniany użytkownik czuje podczas wspomnianego co najmniej jednego czasu, a wspomniany co najmniej jeden raz jest używany do wyświetlenia wspomnianych danych samorealizacji w synchronizacji z co najmniej jedną częścią wspomnianych danych wideo.

11. System do identyfikacji wideo odpowiadającego zdarzeniu biometrycznemu użytkownika, przy czym wspomniane wideo jest wyświetlane wraz z co najmniej jedną biometrią wspomnianego użytkownika podczas wspomnianego zdarzenia biometrycznego, zawierający: co najmniej jeden serwer komunikujący się z siecią rozległą (WAN) ; urządzenie mobilne komunikujące się ze wspomnianym co najmniej jednym serwerem za pośrednictwem wspomnianej sieci WAN, przy czym wspomniane urządzenie mobilne zawiera: wyświetlacz; co najmniej jeden procesor do pobierania instrukcji odczytywalnych maszynowo ze wspomnianego co najmniej jednego serwera; i co najmniej jedno urządzenie pamięciowe do przechowywania wspomnianych instrukcji odczytywalnych maszynowo, przy czym wspomniane instrukcje odczytywalne maszynowo są przystosowane do wykonywania etapów: odbierania żądania rozpoczęcia sesji; przypisywanie numeru sesji i czasu rozpoczęcia do wspomnianej sesji; odbieranie danych wideo z kamery, przy czym wspomniane dane wideo obejmują wideo co najmniej jednego ze wspomnianych użytkowników i otoczenia wspomnianego użytkownika w określonym przedziale czasu; odbieranie danych biometrycznych z czujnika, przy czym wspomniane dane biometryczne obejmują wiele wartości danych biometrycznych wspomnianego użytkownika we wspomnianym okresie; powiązanie co najmniej wspomnianego numeru sesji i wspomnianego czasu rozpoczęcia ze wspomnianymi danymi wideo; powiązanie co najmniej wspomnianego numeru sesji, wspomnianego czasu rozpoczęcia i częstotliwości próbkowania ze wspomnianymi danymi biometrycznymi, przy czym co najmniej wspomniany numer sesji jest używany do połączenia wspomnianych danych biometrycznych ze wspomnianymi danymi wideo, a co najmniej wspomniana częstotliwość próbkowania i wspomniany czas rozpoczęcia są wykorzystywane do powiązać poszczególne ze wspomnianych wielu wartości z indywidualnymi czasami we wspomnianym okresie; odebranie wspomnianego zdarzenia biometrycznego, przy czym wspomniane zdarzenie biometryczne obejmuje jedno z wartości i zakresu wspomnianego zdarzenia biometrycznego; identyfikację pierwszej z wielu wartości odpowiadających wspomnianemu zdarzeniu biometrycznemu; identyfikowanie pierwszego czasu we wspomnianym okresie czasu odpowiadającym wspomnianemu pierwszemu z wielu wspomnianych wartości; i wyświetlanie na wspomnianym wyświetlaczu co najmniej wspomnianych danych wideo podczas wspomnianego pierwszego razu wraz ze wspomnianą pierwszą z wielu wartości, przy czym wspomniany pierwszy czas jest używany do pokazania wspomnianej pierwszej ze wspomnianych wielu wartości w synchronizacji z częścią wspomnianych danych wideo który pokazuje co najmniej jednego ze wspomnianych użytkowników i otoczenie wspomnianego użytkownika podczas wspomnianego zdarzenia biometrycznego.

12. System według zastrzeżenia 11, w którym wspomniany etap odbierania danych biometrycznych ze wspomnianego czujnika obejmuje ponadto odbieranie danych tętna z czujnika tętna.

13. System według zastrzeżenia 11, w którym wspomniane etapy łączenia wspomnianego numeru sesji ze wspomnianymi danymi wideo i wspomnianymi danymi biometrycznymi obejmują ponadto łączenie numeru czynności zarówno ze wspomnianymi danymi wideo, jak i wspomnianymi danymi biometrycznymi, przy czym wspomniany numer czynności identyfikuje jedną z wielu czynności, wspomniana sesja obejmuje wspomnianych wiele czynności, a zarówno wspomniany numer sesji, jak i wspomniany numer czynności, są wykorzystywane do łączenia wspomnianych danych biometrycznych ze wspomnianymi danymi wideo.

14. System według zastrzeżenia 11, w którym wspomniane etapy odbioru danych wideo i danych biometrycznych obejmują ponadto odbiór wspomnianych danych wideo i wspomnianych danych biometrycznych we wspomnianym okresie czasu.

15. System według zastrzeżenia 11, w którym wspomniany etap odbierania danych wideo z kamery obejmuje ponadto odbiór wspomnianych danych wideo z wspomnianej kamery po wspomnianym okresie czasu.

16. System według zastrzeżenia 15, w którym wspomniane instrukcje odczytywalne maszynowo są ponadto przystosowane do wykonywania etapu analizy wspomnianych danych wideo dla kodu kreskowego, przy czym wspomniany kod kreskowy identyfikuje wspomniany numer sesji i jest wykorzystywany do łączenia wspomnianego numeru sesji ze wspomnianymi danymi wideo.

17. System według zastrzeżenia 11, w którym wspomniane etapy identyfikacji pierwszej ze wspomnianych wielu wartości odpowiadających wspomnianej parzystości biometrycznej i identyfikacji pierwszej chwili odpowiadającej wspomnianej pierwszej ze wspomnianych wielu wartości obejmują ponadto identyfikację każdej ze wspomnianych wielu wartości. wartości odpowiadające wspomnianemu zdarzeniu biometrycznemu i identyfikujące za każdym razem odpowiadające wspomnianej każdej ze wspomnianych wielu wartości.

18. System według zastrzeżenia 17, w którym wspomniany etap wyświetlania co najmniej wspomnianych danych wideo podczas wspomnianego pierwszego czasu obejmuje ponadto wyświetlanie co najmniej wspomnianych danych wideo podczas wspomnianego każdego czasu odpowiadającego wspomnianej każdej ze wspomnianych wielu wartości, przy czym wspomniany czas jest stosowane do pokazania każdej ze wspomnianych wielu wartości w synchronizacji z częściami wspomnianych danych wideo, które pokazują co najmniej jednego wspomnianego użytkownika i otoczenie wspomnianego użytkownika podczas wspomnianego zdarzenia biometrycznego.

19. System według zastrzeżenia 11, w którym wspomniane instrukcje odczytywalne maszynowo są ponadto przystosowane do wykonywania etapów odbierania danych dotyczących samorealizacji od wspomnianego użytkownika i łączenia wspomnianego numeru sesji i co najmniej raz ze wspomnianymi danymi samorealizacji, przy czym wspomniane dane dotyczące realizacji wskazują, jak czuje się wspomniany użytkownik podczas wspomnianego co najmniej jednego czasu, a wspomniany co najmniej jeden czas jest używany do wyświetlenia wspomnianych danych samorealizacji w synchronizacji z co najmniej jedną częścią wspomnianych danych wideo.

20. Sposób wyświetlania wideo zsynchronizowanego z co najmniej jedną biometrią pacjenta, obejmujący: wykorzystanie co najmniej jednego programu uruchomionego na urządzeniu komputerowym w celu przypisania numeru sesji i czasu rozpoczęcia wspomnianej sesji; odbieranie danych wideo z co najmniej jednej kamery, przy czym wymienione dane wideo obejmują wideo co najmniej jednego wymienionego podmiotu i jego otoczenia w określonym czasie; odbieranie danych biometrycznych z co najmniej jednego czujnika, przy czym wspomniane dane biometryczne obejmują wiele wartości co najmniej jednej biometrii wymienionego podmiotu we wspomnianym okresie; wykorzystanie co najmniej jednego programu do połączenia co najmniej wspomnianego numeru sesji i wspomnianego czasu rozpoczęcia ze wspomnianymi danymi wideo; wykorzystanie co najmniej jednego programu do połączenia co najmniej wspomnianego numeru sesji, wspomnianego czasu rozpoczęcia i co najmniej jednej częstotliwości próbkowania ze wspomnianymi danymi biometrycznymi; odbieranie zdarzenia biometrycznego, przy czym wspomniane zdarzenie biometryczne obejmuje jedną z wartości i zakres wspomnianych co najmniej jednego zdarzenia biometrycznego; stosowanie co najmniej jednego programu do identyfikacji poszczególnych spośród wielu wartości odpowiadających wspomnianemu zdarzeniu biometrycznemu; stosowanie wspomnianego co najmniej jednego programu i co najmniej wspomnianego czasu rozpoczęcia, wspomnianej co najmniej jednej częstotliwości próbkowania i wspomnianego okresu czasu do identyfikacji poszczególnych czasów we wspomnianym okresie odpowiadającym wspomnianym indywidualnym czasom ze wspomnianych wielu wartości; i wyświetlanie na wspomnianym urządzeniu obliczeniowym co najmniej wspomnianych danych wideo i wspomnianych indywidualnych danych ze wspomnianych wielu wartości, przy czym wspomniane indywidualne czasy są wykorzystywane do pokazania wspomnianych indywidualnych ze wspomnianych wielu wartości w synchronizacji z częściami wspomnianych danych wideo, które pokazują co najmniej jeden wspomnianego podmiotu i jego otoczenia podczas wspomnianego zdarzenia biometrycznego.

Opis:

ODNIESIENIE DO POWIĄZANEGO WNIOSKU

Ta aplikacja jest kontynuacją Ser. Nr 15/293 211, złożony 13 października 2016 r., Zastrzegający pierwszeństwo zgodnie z 35 U.S.C. § 119 (e) do tymczasowego zgłoszenia USA nr 62/240 783, złożonego 13 października 2015 r., Które to zgłoszenia są tutaj w całości włączone przez odniesienie.

TŁO WYNALAZKU

1. Dziedzina wynalazku

Niniejszy wynalazek dotyczy odbioru i wykorzystania danych biometrycznych, a w szczególności systemu i sposobu wyświetlania co najmniej jednej biometrii użytkownika wraz z wideo użytkownika w czasie, gdy co najmniej jeden biometryczny jest mierzony i / lub otrzymane.

2. Opis powiązanego art

Niedawno opracowano urządzenia, które są zdolne do pomiaru, wykrywania lub szacowania w dogodnym współczynniku kształtu co najmniej jednej lub więcej miar związanych z charakterystyką fizjologiczną, powszechnie określanych jako dane biometryczne. Na przykład opracowano urządzenia przypominające zegarki, które są w stanie mierzyć tętno lub tętno osoby i na podstawie tych danych wraz z innymi informacjami (np. Wiek, waga osoby itp.), Aby obliczyć wynik, np. jako suma kalorii spalonych przez osobę w danym dniu. Podobne urządzenia zostały opracowane do pomiaru, wykrywania lub szacowania innych rodzajów wskaźników, takich jak ciśnienie krwi, wzorce oddechu, skład oddechu, wzorce snu i poziom alkoholu we krwi, żeby wymienić tylko kilka. Urządzenia te są ogólnie nazywane urządzeniami biometrycznymi lub urządzeniami biosensorowymi.

Chociaż rodzaje urządzeń biometrycznych wciąż się rozwijają, sposób wykorzystywania danych biometrycznych pozostaje względnie statyczny. Na przykład dane tętna są zwykle używane do podania indywidualnych informacji o ich tętnie i spalonych kaloriach. Jako inny przykład, dane dotyczące alkoholu we krwi są zwykle wykorzystywane do podania jednostce informacji o jej poziomie alkoholu we krwi oraz do poinformowania jej, czy może bezpiecznie lub legalnie prowadzić pojazd mechaniczny. W ramach jeszcze innego przykładu wzorzec oddechowy danej osoby (mierzalny na przykład poprzez poziom głośności w decybelach lub zmiany poziomu decybeli w przedziale czasu) może być monitorowany przez lekarza, pielęgniarkę lub technika medycznego w celu ustalenia, czy cierpi na bezdech senny.

Chociaż dane biometryczne są przydatne same w sobie, takie dane byłyby bardziej informacyjne lub dynamiczne, gdyby można je było łączyć z innymi danymi (np. Danymi wideo itp.), Dostarczanymi (np. Bezprzewodowo, przez sieć itp.) urządzenie zdalne i / lub możliwe do przeszukiwania (np. umożliwiające szybką identyfikację pewnych warunków, takich jak podwyższone tętno) i / lub przeszukiwania krzyżowego (np. przy użyciu danych biometrycznych do identyfikacji sekcji wideo ilustrującej określoną charakterystykę lub nawzajem). W związku z tym istnieje zapotrzebowanie na skuteczny system i sposób, który byłby w stanie osiągnąć przynajmniej niektóre, a nawet wszystkie z powyższych zalet, a także byłby w stanie połączyć dane generowane w formie automatycznej lub ręcznej przez różne urządzenia, które często używają systemy operacyjne lub technologie (np. platformy sprzętowe, protokoły, typy danych itp.), które są ze sobą niekompatybilne.

W niektórych przykładach wykonania niniejszego wynalazku system i / lub sposób jest skonfigurowany do odbierania, zarządzania i filtrowania ilości informacji na czas i w sposób efektywny kosztowo, a także może mieć dodatkową wartość dzięki dokładnemu pomiarowi, wizualizacji ( np. zsynchronizowana wizualizacja itp.) oraz szybkie powiadamianie o punktach danych, które znajdują się poza (lub w) określonym lub predefiniowanym zakresie.

Taki system i / lub metoda może być wykorzystana przez osobę fizyczną (np. Sportowca itp.) Lub ich trenera, trenera itp. Do wizualizacji osoby podczas wykonywania zawodów sportowych (np. Bieganie, jazda na rowerze, podnoszenie ciężarów, gra w piłkę nożną itp.) w czasie rzeczywistym (na żywo) lub później, wraz z równolegle mierzonymi danymi biometrycznymi danej osoby (np. tętno itp.) i / lub jednocześnie zbierane „dane samorealizacji” lub generowane przez podmiot dane empiryczne, w przypadku których osoba wprowadza własne subiektywne stany fizyczne lub psychiczne podczas ćwiczeń, sprawności fizycznej lub aktywności / treningu sportowego (np. odczuwanie przypływu adrenaliny lub endorfin w systemie, uczucie zmęczenia, „drugi oddech”) , ”Itp.). Pozwoliłoby to osobie (np. Osobie fizycznej, trenerowi danej osoby, stronie trzeciej itp.) Monitorować / obserwować fizjologiczne i / lub subiektywne cechy psychologiczne jednostki podczas oglądania lub przeglądu osoby podczas wykonywania zawodów sportowych, lub inną aktywność fizyczną. Takie wprowadzanie danych samorealizacji można osiągnąć różnymi metodami, w tym automatycznymi, umieszczonymi w systemie notatkami głosowymi ze znacznikiem czasu, skrótowymi lub skrótowymi poleceniami klawiszowymi na smartfonie, smartwatchu, włączonej opasce fitness, lub jakąkolwiek inną powiązaną z systemem metodę wprowadzania danych, która jest wygodna dla jednostki, aby nie utrudniać (lub w jak najmniejszym stopniu) przepływu i praktyki osoby w toku.

Taki system i / lub metoda ułatwiłaby również na przykład zdalną obserwację i diagnostykę w zastosowaniach telemedycznych, gdzie istnieje potrzeba, aby personel medyczny, strona monitorująca lub rodzic mieli jasne i szybkie potwierdzenie tożsamości pacjenta. lub niemowlę, a także ich widoczny stan fizyczny, wraz z ich równolegle generowanymi danymi biometrycznymi i / lub samorealizującymi się.

Ponadto system i / lub metoda powinny również zapewniać podmiotowi lub stronie monitorującej sposób wykorzystania indeksowania wideo w celu wydajnego i intuicyjnego porównania, mapowania i oceny danych podmiotu, zarówno w odniesieniu do własnej historii biometrycznej podmiotu, jak i / lub w porównaniu z innymi próbki danych podmiotów lub dane demograficzne, niezależnie od platform operacyjnych lub aplikacji, które zostały użyte do wygenerowania informacji biometrycznych i wideo. Dzięki możliwości filtrowania / wyszukiwania określonych zdarzeń (np. Zdarzeń biometrycznych, zdarzeń samorealizacji, zdarzeń fizycznych itp.), Pozyskane dane można zredukować lub edytować (np. W celu utworzenia „rolki z podświetleniem” itp.). ) przy jednoczesnym zachowaniu synchronizacji pomiędzy poszczególnymi segmentami wideo a zmierzonymi i / lub zebranymi danymi (np. dane biometryczne, dane samorealizacji, dane GPS itp.). Takie kompleksowe indeksowanie zdarzeń, a wraz z nim możliwość przeprowadzenia strukturalnej agregacji powiązanych danych (wideo i innych) z danymi (lub bez) od innych osób lub innych odpowiednich źródeł, można również wykorzystać do zapewnienia bogatszego poziomu informacji przy użyciu metody analizy „Big Data” i „Machine Learning” oraz dodawanie sztucznej inteligencji („AI”) w celu realizacji zaleceń i wezwań do działania.

STRESZCZENIE WYNALAZKU

Niniejszy wynalazek zapewnia system i sposób wykorzystywania, przetwarzania, indeksowania, analizy porównawczej, rankingu, porównywania i wyświetlania danych biometrycznych lub ich wyniku, samodzielnie lub łącznie (np. W synchronizacji) z innymi danymi (np. Danymi wideo itp.) .). Korzystne przykłady wykonania niniejszego wynalazku działają zgodnie z urządzeniem komputerowym (np. Smartfonem itp.) W komunikacji z co najmniej jednym urządzeniem zewnętrznym (np. Urządzeniem biometrycznym do pozyskiwania danych biometrycznych, urządzeniem wideo do uzyskiwania danych wideo, itp.). W pierwszym przykładzie wykonania niniejszego wynalazku dane wideo, które mogą obejmować dane audio i dane inne niż wideo, takie jak dane biometryczne, są przechowywane oddzielnie na urządzeniu obliczeniowym i połączone z innymi danymi, co umożliwia wyszukiwanie i synchronizację wideo. i inne niż wideo.

W jednym przykładzie wykonania niniejszego wynalazku aplikacja (np. Działająca na urządzeniu obliczeniowym itp.) Zawiera wiele modułów do wykonywania wielu funkcji. Na przykład aplikacja może obejmować moduł przechwytywania wideo do odbierania danych wideo z kamery wewnętrznej i / lub zewnętrznej oraz moduł przechwytywania biometrycznego do odbierania danych biometrycznych z wewnętrznego i / lub zewnętrznego urządzenia biometrycznego. Platforma klienta może również zawierać moduł interfejsu użytkownika, umożliwiający użytkownikowi interakcję z platformą, moduł edycji wideo do edycji danych wideo, moduł obsługi plików do zarządzania danymi, moduł bazy danych i synchronizacji do replikacji danych, moduł algorytmu do przetwarzanie otrzymanych danych, moduł udostępniania do udostępniania i / lub przechowywania danych oraz centralny moduł logowania i identyfikatora do łączenia się z witrynami społecznościowymi stron trzecich, takimi jak Facebook ™.

Moduły te mogą być używane, na przykład, do rozpoczynania nowej sesji, odbierania danych wideo z sesji (tj. Za pośrednictwem modułu przechwytywania wideo) i odbierania danych biometrycznych dotyczących sesji (tj. Za pośrednictwem modułu przechwytywania biometrycznego). Dane te mogą być przechowywane w pamięci lokalnej, w lokalnej bazie danych i / lub na zdalnym urządzeniu magazynującym (np. W chmurze firmy lub w usłudze chmurowej strony trzeciej, takiej jak Dropbox ™ itp.). W korzystnym przykładzie wykonania dane są przechowywane tak, że są połączone z informacją, która (i) identyfikuje sesję i (ii) umożliwia synchronizację.

Na przykład, dane wideo są korzystnie połączone co najmniej z czasem rozpoczęcia (np. Godziną rozpoczęcia sesji) i identyfikatorem. Identyfikatorem może być pojedyncza liczba jednoznacznie identyfikująca sesję lub wiele liczb (np. Wiele globalnych lub uniwersalnych unikalnych identyfikatorów (GUID / UUID)), gdzie pierwsza liczba jednoznacznie identyfikuje sesję, a druga liczba jednoznacznie identyfikuje aktywność w sesji, umożliwiając sesji obejmowanie wielu czynności. Identyfikator może również zawierać nazwę sesji i / lub opis sesji. Inne informacje o danych wideo (np. Długość wideo, źródło wideo itp.) (Tj. „Metadane wideo”) również mogą być przechowywane i łączone z danymi wideo. Dane biometryczne są korzystnie powiązane co najmniej z czasem rozpoczęcia (np. Ten sam czas rozpoczęcia powiązany z danymi wideo), identyfikator (np. Ten sam identyfikator powiązany z danymi wideo) i jakie dane biometryczne są odbierane i / lub przechowywane.

Po zapisaniu i połączeniu danych wideo i biometrycznych można użyć algorytmów do wspólnego wyświetlania danych. Na przykład, jeśli dane biometryczne są przechowywane z częstotliwością próbkowania 30 próbek na minutę (spm), algorytmy mogą być użyte do wyświetlenia pierwszej wartości biometrycznej (np. Poniżej danych wideo, nałożonej na dane wideo itp.) początek klipu wideo, druga wartość biometryczna dwie sekundy później (dwie sekundy w klipie wideo), trzecia wartość biometryczna dwie sekundy później (cztery sekundy klipu wideo) itd. W alternatywnych przykładach wykonania niniejszego wynalazku nie dane wideo (np. dane biometryczne, dane samorealizacji itp.) mogą być przechowywane z wieloma znacznikami czasu (np. indywidualne znaczniki lub przesunięcia dla każdej przechowywanej wartości lub indywidualne częstotliwości próbkowania dla każdego typu danych), które mogą być używane razem z czasem rozpoczęcia do synchronizacji danych innych niż wideo z danymi wideo.

W jednym przykładzie wykonania niniejszego wynalazku urządzenie biometryczne może zawierać czujnik do wykrywania danych biometrycznych, wyświetlacz do interakcji z użytkownikiem i wyświetlania różnych informacji (np. Danych biometrycznych, danych konfiguracyjnych, danych operacyjnych, takich jak start, stop , i pauza, itp.), pamięć do przechowywania wykrytych danych biometrycznych, nadajnik-odbiornik do komunikacji z przykładowym urządzeniem komputerowym oraz procesor do obsługi i / lub sterowania transceiverem, pamięcią, czujnikiem i wyświetlaczem. Przykładowe urządzenie komputerowe zawiera nadajnik-odbiornik (1) do odbierania danych biometrycznych z przykładowego urządzenia biometrycznego, pamięć do przechowywania danych biometrycznych, wyświetlacz do łączenia się z użytkownikiem i wyświetlania różnych informacji (np. Dane biometryczne, dane konfiguracyjne, dane operacyjne, takie jak uruchamianie, zatrzymywanie i pauza, wprowadzanie komentarzy podczas sesji lub dodawanie notatek głosowych itp.), klawiatura (lub inne dane wejściowe użytkownika) do odbierania danych wejściowych użytkownika, nadajnik-odbiornik (2) do dostarczania danych biometrycznych do głównego urządzenia komputerowego za pośrednictwem Internetu i procesora do obsługi i / lub sterowania transceiverem (1), transiwerem (2), klawiaturą, wyświetlaczem i pamięcią.

Klawiatura (lub inne urządzenie wejściowe) w urządzeniu komputerowym lub alternatywnie klawiatura (lub inne urządzenie wejściowe) w urządzeniu biometrycznym może służyć do wprowadzania danych dotyczących samorealizacji lub danych o tym, jak użytkownik czuje się w określonym czasie . Na przykład, jeśli użytkownik czuje się zmęczony, może wpisać „T” na klawiaturze. Jeśli użytkownik czuje, że zaczynają im endorfiny, może wpisać „E” na klawiaturze. A jeśli użytkownik łapie drugi oddech, może wpisać „S” na klawiaturze. Alternatywnie, aby jeszcze bardziej ułatwić obsługę podczas ćwiczeń lub aktywności sportowej, można wstępnie przypisać przyciski z krótkim kodem, takie jak „T”, „E” i „S”, podobnie jak numery szybkiego wybierania telefonów do często wybieranych kontaktów na smartfonie. telefon itp., które można wybrać ręcznie lub za pomocą rozpoznawania głosu. Te dane (np. Wpis lub jego reprezentacja) są następnie przechowywane i łączone z częstotliwością próbkowania (np. Danymi biometrycznymi) lub danymi znacznika czasu, które mogą być czasem lub przesunięciem względem czasu rozpoczęcia naciśnięcia każdego przycisku. Pozwoliłoby to na synchronizację danych samorealizacji z danymi wideo. Pozwoliłoby to również na przeszukiwanie lub filtrowanie danych samorealizacji, takich jak dane biometryczne (np. W celu znalezienia wideo odpowiadającego danemu wydarzeniu, np. Gdy użytkownik poczuł się zmęczony itp.).

W alternatywnym przykładzie wykonania niniejszego wynalazku urządzenie komputerowe (np. Smartfon itp.) Również komunikuje się z głównym urządzeniem komputerowym za pośrednictwem sieci rozległej („WAN”), takiej jak Internet. Ten przykład wykonania umożliwia urządzeniu komputerowemu pobieranie aplikacji z głównego urządzenia obliczeniowego, przenoszenie co najmniej niektórych z wyżej określonych funkcji na główne urządzenie komputerowe i przechowywanie danych na głównym urządzeniu komputerowym (np. Zezwalanie na dane wideo, samodzielnie lub zsynchronizowane. do danych innych niż wideo, takich jak dane biometryczne i dane samorealizacji, które mają być przeglądane przez inne urządzenie sieciowe). Na przykład oprogramowanie działające na urządzeniu komputerowym (np. Aplikacja, program itp.) Może umożliwiać użytkownikowi odtwarzanie danych wideo i / lub audio, ale nie może synchronizować danych wideo i / lub audio z danymi biometrycznymi. . Może to być spowodowane tym, że główne urządzenie komputerowe jest używane do przechowywania danych krytycznych dla synchronizacji (indeks znacznika czasu, metadane, dane biometryczne, częstotliwość próbkowania itp.) I / lub oprogramowanie działające na głównym urządzeniu komputerowym jest niezbędne do synchronizacji. W ramach innego przykładu oprogramowanie działające na urządzeniu komputerowym może umożliwiać użytkownikowi odtwarzanie danych wideo i / lub audio, samodzielnie lub zsynchronizowanych z danymi biometrycznymi, ale może nie zezwalać na urządzenie komputerowe (lub może ograniczać zdolność) do wyszukiwania lub ekstrapolacji w inny sposób z danych biometrycznych lub ich przetwarzania w celu zidentyfikowania odpowiednich części (np. które mogą zostać wykorzystane do stworzenia „zbioru wyróżnień” zsynchronizowanych danych wideo / audio / biometrycznych) lub do uszeregowania danych biometrycznych i / lub dane wideo. Może to być spowodowane tym, że główne urządzenie komputerowe jest używane do przechowywania danych krytycznych do wyszukiwania i / lub uszeregowania danych biometrycznych (dane biometryczne, metadane biometryczne itp.) I / lub oprogramowania niezbędnego do wyszukiwania (lub wykonywania zaawansowanego wyszukiwania) i / lub uszeregowanie (lub zaawansowane uszeregowanie) danych biometrycznych.

W jednym przykładzie wykonania niniejszego wynalazku dane wideo, które mogą również zawierać dane audio, rozpoczynają się w czasie „T” i trwają przez czas „n”. Dane wideo są korzystnie przechowywane w pamięci (lokalnie i / lub zdalnie) i połączone z innymi danymi, takimi jak identyfikator, czas rozpoczęcia i czas trwania. Takie dane wiążą dane wideo co najmniej z określoną sesją, określonym czasem rozpoczęcia i identyfikują czas trwania zawartego w nich wideo. W jednym przykładzie wykonania niniejszego wynalazku każda sesja może obejmować różne zajęcia. Na przykład wycieczka do Berlina w określonym dniu (sesja) może obejmować przejażdżkę rowerem po mieście (pierwsze zajęcie) i spacer po parku (drugie zajęcie). W związku z tym identyfikator może zawierać zarówno identyfikator sesji, jednoznacznie identyfikujący sesję za pomocą globalnie unikalnego identyfikatora (GUID), jak i identyfikator działania, jednoznacznie identyfikujący działanie za pomocą globalnie unikalnego identyfikatora (GUID), gdzie relacja sesja / aktywność jest taka rodzica / dziecka.

W jednym przykładzie wykonania niniejszego wynalazku dane biometryczne są przechowywane w pamięci i połączone z identyfikatorem i częstotliwością próbkowania „m”. Pozwala to na połączenie danych biometrycznych z danymi wideo podczas odtwarzania. Na przykład, jeśli identyfikator to jeden, czas rozpoczęcia to 13:00, czas trwania wideo to jedna minuta, a częstotliwość próbkowania to 30 spm, wówczas odtworzenie wideo o godzinie 14:00 spowoduje, że pierwsza wartość biometryczna będzie wyświetlana (np. pod wideo, nad wideo itp.) o 14:00, druga wartość biometryczna do wyświetlenia (np. pod wideo, nad wideo itp.) dwie sekundy później i tak dalej, aż film kończy się o 14:01. Chociaż dane samorealizacji mogą być przechowywane jak dane biometryczne (np. Połączone z częstotliwością próbkowania), jeśli takie dane są otrzymywane tylko okresowo, korzystniejsze może być przechowywanie tych danych połączonych z identyfikatorem i znacznikiem czasu, gdzie „ m ”to albo czas, w którym otrzymano dane samorealizacji, albo przesunięcie między tym czasem a czasem rozpoczęcia (np. dziesięć minut i cztery sekundy po godzinie rozpoczęcia itd.). Przechowując oddzielnie od siebie dane wideo i inne niż wideo, można łatwo wyszukiwać i synchronizować dane.

W odniesieniu do łączenia danych z identyfikatorem, który może być powiązany z innymi danymi (np. Czas rozpoczęcia, częstotliwość próbkowania itp.), Jeżeli dane są odbierane w czasie rzeczywistym, dane można powiązać z identyfikatorem (-ami) dla bieżącej sesji (i / lub działania). Jednakże, gdy dane są odbierane po fakcie (np. Po zakończeniu sesji), istnieje kilka sposobów, w jakie dane można powiązać z określoną sesją i / lub działaniem (lub identyfikatorem (-ami) z nimi związanymi). Dane mogą być łączone ręcznie (np. Przez użytkownika) lub automatycznie poprzez aplikację. W tym ostatnim przypadku można to osiągnąć na przykład porównując czas trwania odebranych danych (np. Długość wideo) z czasem trwania sesji i / lub aktywności, zakładając, że odebrane dane są związane z ostatnia sesja i / lub aktywność lub analiza danych zawartych w otrzymanych danych. Na przykład, w jednym przykładzie wykonania, dane zawarte w odebranych danych (np. Metadane) mogą identyfikować czas i / lub lokalizację związaną z danymi, które mogą być następnie wykorzystane do połączenia odebranych danych z sesją i / lub działaniem. W innym przykładzie wykonania urządzenie komputerowe może wyświetlać dane (np. Kod kreskowy, taki jak kod QR, itp.), Które identyfikują sesję i / lub aktywność. Zewnętrzny rejestrator wideo mógłby rejestrować dane identyfikacyjne (wyświetlane przez urządzenie komputerowe) wraz z (np. Przed, po lub w trakcie) użytkownika i / lub jego otoczenia. Aplikacja może następnie przeszukiwać dane wideo w celu identyfikacji danych i wykorzystywać te dane do łączenia danych wideo z sesją i / lub działaniem. Identyfikująca część danych wideo może następnie zostać usunięta przez aplikację w razie potrzeby.

Pełniejsze zrozumienie systemu i metody wykorzystywania, przetwarzania i wyświetlania danych biometrycznych lub ich rezultatów będzie możliwe dla specjalistów w tej dziedzinie, jak również uświadomienie sobie dodatkowych zalet i ich celów poprzez uwzględnienie następujący szczegółowy opis korzystnego przykładu wykonania. Należy odnieść się do załączonych arkuszy rysunków, które zostaną najpierw krótko opisane.

KRÓTKI OPIS RYSUNKÓW

FIGA. 1 ilustruje system do wykorzystywania, przetwarzania i wyświetlania danych biometrycznych oraz do synchronizacji danych biometrycznych z innymi danymi (np. Danymi wideo, danymi audio, itp.) Zgodnie z jednym przykładem wykonania niniejszego wynalazku;

FIGA. 2A ilustruje system do wykorzystywania, przetwarzania i wyświetlania danych biometrycznych oraz do synchronizacji danych biometrycznych z innymi danymi (np. Danymi wideo, danymi audio itp.) Zgodnie z innym przykładem wykonania niniejszego wynalazku;

FIGA. 2B ilustruje system do wykorzystywania, przetwarzania i wyświetlania danych biometrycznych oraz do synchronizacji danych biometrycznych z innymi danymi (np. Danymi wideo, danymi audio, itp.) Zgodnie z jeszcze innym przykładem wykonania niniejszego wynalazku;

FIGA. 3 ilustruje przykładowe wyświetlanie danych wideo zsynchronizowanych z danymi biometrycznymi zgodnie z jednym przykładem wykonania niniejszego wynalazku;

FIGA. 4 ilustruje schemat blokowy do wykorzystywania, przetwarzania i wyświetlania danych biometrycznych oraz do synchronizacji danych biometrycznych z innymi danymi (np. Danymi wideo, danymi audio itp.) Zgodnie z jednym przykładem wykonania niniejszego wynalazku;

FIGA. 5 ilustruje schemat blokowy do wykorzystywania, przetwarzania i wyświetlania danych biometrycznych oraz do synchronizacji danych biometrycznych z innymi danymi (np. Danymi wideo, danymi audio itp.) Zgodnie z innym przykładem wykonania niniejszego wynalazku;

FIGA. 6 ilustruje sposób synchronizacji danych wideo z danymi biometrycznymi, obsługi danych wideo i wyszukiwania danych biometrycznych, zgodnie z jednym przykładem wykonania niniejszego wynalazku;

FIGA. 7 przedstawia przykładowe wyświetlanie danych wideo zsynchronizowanych z danymi biometrycznymi zgodnie z innym przykładem wykonania niniejszego wynalazku;

FIGA. 8 przedstawia przykładowe dane wideo, które są korzystnie połączone z identyfikatorem (ID), czasem rozpoczęcia (T) i czasem zakończenia lub czasem trwania (n);

FIGA. 9 przedstawia przykładowy identyfikator (ID), zawierający identyfikator sesji i identyfikator czynności;

FIGA. 10 ilustruje przykładowe dane biometryczne, które są korzystnie połączone z identyfikatorem (ID), czasem rozpoczęcia (T) i częstotliwością próbkowania (S);

FIGA. 11 ilustruje przykładowe dane dotyczące samorealizacji, które są korzystnie połączone z identyfikatorem (ID) i czasem (m);

FIGA. 12 ilustruje, w jaki sposób pobrane próbki danych biometrycznych można wykorzystać do ekstrapolacji innego punktu danych biometrycznych zgodnie z jednym przykładem wykonania niniejszego wynalazku;

FIGA. 13 ilustruje, w jaki sposób pobrane próbki danych biometrycznych można wykorzystać do ekstrapolacji innych punktów danych biometrycznych zgodnie z innym przykładem wykonania niniejszego wynalazku;

FIGA. 14 ilustruje przykład, w jaki sposób czas rozpoczęcia i dane z nim związane (np. Częstotliwość próbkowania itp.) Mogą być wykorzystane do zsynchronizowania danych biometrycznych i danych samorealizacji z danymi wideo;

FIGA. 15 przedstawia przykładowy zrzut ekranu „logowania” dla aplikacji, która umożliwia użytkownikowi przechwytywanie przynajmniej danych wideo i biometrycznych użytkownika wykonującego zawody sportowe (np. Jazda na rowerze itp.) Oraz wspólne wyświetlanie danych wideo (lub w synchronizacji) z danymi biometrycznymi;

FIGA. 16 przedstawiają przykładowy zrzut ekranu „tworzenia sesji” dla aplikacji przedstawionej na FIG. 15, umożliwiając użytkownikowi utworzenie nowej sesji;

FIGA. 17 przedstawia przykładowy zrzut ekranu „nazwa sesji” dla aplikacji przedstawionej na FIG. 15, umożliwiając użytkownikowi wprowadzenie nazwy sesji;

FIGA. 18 przedstawia przykładowy zrzut ekranu „opisu sesji” dla aplikacji przedstawionej na FIG. 15, umożliwiając użytkownikowi wprowadzenie opisu sesji;

FIGA. 19 przedstawia przykładowy zrzut ekranu „rozpoczęta sesja” dla aplikacji przedstawionej na FIG. 15, przedstawiający wideo i dane biometryczne otrzymane w czasie rzeczywistym;

FIGA. 20 przedstawia przykładowy zrzut ekranu „sesji przeglądowej” dla aplikacji przedstawionej na FIG. 15, umożliwiając użytkownikowi odtworzenie sesji w późniejszym czasie;

FIGA. 21 przedstawia przykładowy zrzut ekranu „opcji wyświetlania wykresu” dla aplikacji przedstawionej na FIG. 15, umożliwiając użytkownikowi wybór danych (np. Danych tętna itp.), Które mają być wyświetlane wraz z danymi wideo;

FIGA. 22 przedstawia przykładowy zrzut ekranu „sesji przeglądu” dla aplikacji przedstawionej na FIG. 15, gdzie dane wideo są wyświetlane razem (lub w synchronizacji) z danymi biometrycznymi;

FIGA. 23 przedstawia przykładowy zrzut ekranu „mapy” dla aplikacji przedstawionej na FIG. 15, pokazujący dane GPS wyświetlane na mapie Google;

FIGA. 24 przedstawia przykładowy zrzut ekranu „podsumowujący” dla aplikacji przedstawionej na FIG. 15, pokazujący podsumowanie sesji;

FIGA. 25 przedstawia przykładowy zrzut ekranu „wyszukiwania biometrycznego” dla aplikacji przedstawionej na FIG. 15, umożliwiając użytkownikowi przeszukiwanie danych biometrycznych pod kątem konkretnego zdarzenia biometrycznego (np. Określonej wartości, określonego zakresu itp.);

FIGA. 26 przedstawia przykładowy zrzut ekranu „pierwszego wyniku” dla aplikacji przedstawionej na FIG. 15, przedstawiający pierwszy wynik dla zdarzenia biometrycznego przedstawionego na FIG. 25, wraz z odpowiednim wideo;

FIGA. 27 przedstawia przykładowy zrzut ekranu „drugiego wyniku” dla aplikacji przedstawionej na FIG. 15, przedstawiający drugi wynik dla zdarzenia biometrycznego przedstawionego na FIG. 25, wraz z odpowiednim wideo;

FIGA. 28 przedstawia przykładowy zrzut ekranu „wyszukiwanie sesji” dla aplikacji przedstawionej na FIG. 15, umożliwiając użytkownikowi wyszukiwanie sesji spełniających określone kryteria; i

FIGA. 29 przedstawia przykładowy zrzut ekranu „listy” dla aplikacji przedstawionej na FIG. 15, przedstawiający wynik dla kryteriów przedstawionych na FIG. 28.

SZCZEGÓŁOWY OPIS KORZYSTNEGO PRZYKŁADU WYKONANIA

Niniejszy wynalazek zapewnia system i sposób wykorzystywania, przetwarzania, indeksowania, analizy porównawczej, rankingu, porównywania i wyświetlania danych biometrycznych lub ich wyniku, samodzielnie lub łącznie (np. W synchronizacji) z innymi danymi (np. Danymi wideo itp.) .). Należy zauważyć, że chociaż wynalazek jest tu opisany w odniesieniu do pewnych danych biometrycznych (np. Częstość akcji serca, wzorce oddechowe, poziom alkoholu we krwi itp.), Wynalazek nie jest tak ograniczony i może być stosowany w połączeniu z dowolnymi dane biometryczne i / lub fizyczne, w tym między innymi poziom tlenu, poziom CO2, wysycenie tlenem, ciśnienie krwi, poziom glukozy we krwi, czynność płuc, ciśnienie w oku, warunki ciała i otoczenia (temperatura, wilgotność, poziom światła, wysokość i barometr ciśnienie), prędkość (prędkość chodzenia, prędkość biegu), lokalizacja i przebyta odległość, częstość oddechów, zmienność tętna (HRV), dane EKG, poziom pocenia się, spalone i / lub spalone kalorie, ketony, zawartość i / lub poziomy wydzielanych odpadów, poziomy hormonów, zawartość krwi, zawartość śliny, poziomy słyszalności (np. chrapanie itp.), poziomy i zmiany nastroju, galwaniczna reakcja skóry, fale mózgowe i / lub aktywność lub inne pomiary neurologiczne, wzorce snu, cechy fizyczne (np. wzrost, waga , kolor oczu, kolor włosów, dane tęczówki, odciski palców itp.) lub reakcje (np. zmiany twarzy, zmiany tęczówki (lub poczwarki), zmiany głosu (lub tonu) itp.) lub jakiekolwiek ich połączenie lub wynik.

Jak pokazano na RYS. 1, urządzenie biometryczne 110 może komunikować się z urządzeniem komputerowym 108, takim jak smartfon, który z kolei komunikuje się z co najmniej jednym urządzeniem komputerowym (102, 104, 106) za pośrednictwem sieci rozległej („ WAN ”) 100, na przykład Internet. Urządzenia komputerowe mogą być różnego typu, takie jak komputer stacjonarny, laptop, tablet, smartfon, inteligentny zegarek itp., Wykorzystujące jeden lub różne systemy operacyjne lub platformy. W jednym przykładzie wykonania niniejszego wynalazku urządzenie biometryczne 110 jest skonfigurowane do pozyskiwania (np. Pomiaru, wykrywania, szacowania itp.) Tętna osoby (np. Danych biometrycznych). Dane biometryczne są następnie dostarczane do urządzenia obliczeniowego 108, które zawiera rejestrator wideo i / lub audio (nie pokazano).

W pierwszym przykładzie wykonania niniejszego wynalazku dane wideo i / lub audio są dostarczane wraz z danymi tętna do głównego urządzenia obliczeniowego 106 za pośrednictwem sieci 100. Ponieważ równoczesne dane wideo i / lub audio oraz dane dotyczące tętna są dostarczona do głównego urządzenia komputerowego 106, działająca na nim aplikacja hosta (niepokazana) może być wykorzystana do synchronizacji danych wideo, danych audio i / lub danych dotyczących tętna, umożliwiając w ten sposób użytkownikowi (np. poprzez urządzenia komputerowe 102 użytkownika), 104) w celu przeglądania danych wideo i / lub słuchania danych audio (w czasie rzeczywistym lub z opóźnieniem czasowym) podczas przeglądania danych biometrycznych. Na przykład, jak pokazano na FIG. 3, aplikacja główna może wykorzystywać znacznik czasu 320 lub inną metodę sekwencjonowania wykorzystującą metadane, aby zsynchronizować dane wideo 310 z danymi biometrycznymi 330, umożliwiając użytkownikowi przeglądanie, na przykład, osoby (np. Pacjenta w szpitalu). , dziecko w łóżeczku itp.) w określonym czasie 340 (np. 76 sekund po godzinie rozpoczęcia) i dane biometryczne związane z osobą w tym konkretnym czasie 340 (np. 76 sekund po godzinie rozpoczęcia).

Należy zauważyć, że aplikacja hosta może być ponadto skonfigurowana do wykonywania innych funkcji, takich jak wyszukiwanie określonej czynności w danych wideo, danych audio, danych biometrycznych i / lub metadanych i / lub rankingu danych wideo, danych audio i / lub lub dane biometryczne. Na przykład aplikacja hosta może umożliwić użytkownikowi wyszukanie określonego zdarzenia biometrycznego, takiego jak tętno, które przekroczyło określony próg lub wartość, tętno, które spadło poniżej określonego progu lub wartości, określone tętno ( lub zakres) przez minimalny okres czasu itp. W innym przykładzie aplikacja hosta może uszeregować dane wideo, dane audio, dane biometryczne lub wiele zsynchronizowanych klipów (np. rolek z podświetleniem) chronologicznie, według wielkości biometrycznej ( od najwyższego do najniższego, od najniższego do najwyższego itd.), według recenzji (od najlepszego do najgorszego, od najgorszego do najlepszego itd.) lub według wyświetleń (od największego do najmniej, najmniej do większości itd.). Należy ponadto zauważyć, że takie funkcje, jak ranking, wyszukiwanie i analiza danych nie ograniczają się do indywidualnej sesji użytkownika, ale mogą być wykonywane w ramach dowolnej liczby indywidualnych sesji użytkownika, jak również sesji lub liczby sesji. wielu użytkowników. Jednym z zastosowań tego zbioru wszystkich różnych informacji (wideo, biometrycznych i innych) jest możliwość generowania wystarczających punktów danych do analizy Big Data i uczenia maszynowego w celu generowania wniosków i zaleceń dotyczących sztucznej inteligencji.

Na przykład algorytmy uczenia maszynowego można wykorzystać do automatycznego przeszukiwania danych wideo w celu wyszukania najbardziej atrakcyjnych treści, które następnie zostałyby połączone w krótki „film z wyróżnieniem”. Sieć neuronową można trenować przy użyciu wielu sportowych filmów wideo, wraz z ocenami użytkowników na temat ich poziomu zainteresowania w miarę postępu wideo. Węzły wejściowe do sieci mogą być próbką zmiany intensywności pikseli między ramkami wraz z medianą oceny podniecenia bieżącej ramki. Algorytmy uczenia maszynowego można również wykorzystać, w połączeniu z wielowarstwową konwolucyjną siecią neuronową, do automatycznej klasyfikacji treści wideo (np. Jaki sport jest w filmie). Po zidentyfikowaniu treści, automatycznie lub ręcznie, można użyć algorytmów, aby porównać aktywność użytkownika z wyidealizowaną aktywnością. Na przykład system może porównać nagranie wideo zamachu użytkownika w golfa z nagraniem profesjonalnego golfisty. System mógłby następnie dostarczać użytkownikowi przyrostowych wskazówek, w jaki sposób użytkownik może poprawić swój swing. Algorytmy można również wykorzystać do przewidywania poziomów sprawności dla użytkowników (np. Jeśli utrzymują swój program, dając im motywację do kontynuowania ćwiczeń), dopasowywania użytkowników do innych użytkowników lub praktyków o podobnym poziomie sprawności i / lub tworzenia procedur zoptymalizowanych dla każdego z nich. użytkownik.

Należy również docenić, jak pokazano na FIG. 2A, że dane biometryczne mogą być dostarczane do głównego urządzenia obliczeniowego 106 bezpośrednio, bez przechodzenia przez urządzenie obliczeniowe 108. Na przykład, urządzenie obliczeniowe 108 i urządzenie biometryczne 110 mogą komunikować się niezależnie z głównym urządzeniem komputerowym, bezpośrednio lub za pośrednictwem sieć 100. Należy ponadto zauważyć, że dane wideo, dane audio i / lub dane biometryczne nie muszą być dostarczane do głównego urządzenia komputerowego 106 w czasie rzeczywistym. Na przykład dane wideo mogą zostać dostarczone w późniejszym czasie, o ile można je zidentyfikować lub powiązać z określoną sesją. Jeśli dane wideo można zidentyfikować, można je następnie zsynchronizować z innymi danymi (np. Danymi biometrycznymi) otrzymanymi w czasie rzeczywistym.

W jednym przykładzie wykonania niniejszego wynalazku, jak pokazano na FIG. 2B, system zawiera urządzenie obliczeniowe 200, takie jak smartfon, komunikujące się z wieloma urządzeniami, w tym z głównym urządzeniem komputerowym 240 za pośrednictwem sieci WAN (patrz np. FIG. 1 w 100), urządzenia strony trzeciej 250 przez sieć WAN (patrz np. RYS. 1 w punkcie 100) i urządzenia lokalne 230 (np. za pośrednictwem połączeń bezprzewodowych lub przewodowych). W korzystnym przykładzie wykonania urządzenie obliczeniowe 200 pobiera program lub aplikację (tj. Platformę klienta) z głównego urządzenia komputerowego 240 (np. Chmury firmowej). Platforma klienta zawiera wiele modułów, które są skonfigurowane do wykonywania wielu funkcji.

Na przykład, platforma klienta może zawierać moduł 210 przechwytywania wideo do odbierania danych wideo z kamery wewnętrznej i / lub zewnętrznej, oraz moduł 212 przechwytywania biometrycznego do odbierania danych biometrycznych z wewnętrznego i / lub zewnętrznego urządzenia biometrycznego. Platforma klienta może również zawierać moduł interfejsu użytkownika 202, umożliwiający użytkownikowi interakcję z platformą, moduł 204 edycji wideo do edycji danych wideo, moduł obsługi plików 206 do zarządzania (np. Przechowywanie, łączenie itp.) Danymi ( np. dane wideo, dane biometryczne, dane identyfikacyjne, dane o czasie rozpoczęcia, dane o czasie trwania, dane dotyczące częstotliwości próbkowania, dane samorealizacji, dane znacznika czasu itp.), baza danych i moduł synchronizacji 214 do replikacji danych (np. kopiowanie danych przechowywany na urządzeniu komputerowym 200 do głównego urządzenia komputerowego 240 i / lub kopiowanie danych użytkownika przechowywanych na głównym urządzeniu komputerowym 240 do urządzenia komputerowego 200), moduł algorytmu 216 do przetwarzania odebranych danych (np. synchronizacja danych, wyszukiwanie / filtrowanie danych , tworzenie nagrania z najważniejszymi fragmentami itp.), moduł udostępniania 220 do udostępniania i / lub przechowywania danych (np. danych wideo, nagrania z najważniejszymi fragmentami itp.) odnoszących się do jednej lub wielu sesji oraz centralnego modułu logowania i identyfikatora 218 do łączenia się z innymi użytkownikami społecznościowymi dia, takie jak Facebook ™.

W odniesieniu do FIG. 2B, urządzenie komputerowe 200, które może być smartfonem, tabletem lub jakimkolwiek innym urządzeniem komputerowym, może być skonfigurowane do pobierania platformy klienta z urządzenia komputerowego hosta 240. Gdy platforma klienta jest uruchomiona na urządzeniu komputerowym 200, platforma może być wykorzystywana do rozpoczynania nowej sesji, odbierania danych wideo dla sesji (tj. poprzez moduł przechwytywania wideo 210) i odbierania danych biometrycznych dla sesji (tj. poprzez moduł przechwytywania biometrycznego 212). Dane te mogą być przechowywane w pamięci lokalnej, w lokalnej bazie danych i / lub na zdalnym urządzeniu magazynującym (np. W chmurze firmy lub chmurze strony trzeciej, takiej jak Dropbox ™ itp.). W korzystnym przykładzie wykonania dane są przechowywane tak, że są połączone z informacją, która (i) identyfikuje sesję i (ii) umożliwia synchronizację.

Na przykład, dane wideo są korzystnie połączone co najmniej z czasem rozpoczęcia (np. Godziną rozpoczęcia sesji) i identyfikatorem. Identyfikatorem może być pojedyncza liczba jednoznacznie identyfikująca sesję lub wiele liczb (np. Wiele globalnych (lub uniwersalnych) unikalnych identyfikatorów (GUID / UUID), gdzie pierwsza liczba jednoznacznie identyfikuje sesję i druga liczba jednoznacznie identyfikuje czynność w ramach sesji, umożliwiająca sesję (np. podróż do lub plan podróży w miejscu docelowym, takim jak Berlin), na włączenie wielu działań (np. przejażdżka rowerem, spacer itp.). jedynie identyfikator aktywności (lub sesji) może być identyfikatorem 128-bitowym, który ma wysokie prawdopodobieństwo niepowtarzalności, na przykład 8bf25512-f17a-4e9e-b49a-7c3f59ec1e85). Identyfikator może również zawierać nazwę sesji i / lub opis sesji. Inne informacje o danych wideo (np. Długość wideo, źródło wideo itp.) (Tj. „Metadane wideo”) również mogą być przechowywane i łączone z danymi wideo. Dane biometryczne są korzystnie powiązane co najmniej z czasem rozpoczęcia (np. Ten sam czas rozpoczęcia powiązany z danymi wideo), identyfikator (np. Ten sam identyfikator powiązany z danymi wideo) i jakie dane biometryczne są odbierane i / lub przechowywane. Na przykład, dane dotyczące tętna mogą być odbierane i przechowywane z częstotliwością trzydziestu próbek na minutę (30 spm), tj. Raz na dwie sekundy, lub z inną z góry określoną próbką z interwałem czasowym.

W niektórych przypadkach częstotliwość próbkowania używana przez platformę może być częstotliwością próbkowania urządzenia biometrycznego (tj. Szybkością, z jaką dane są dostarczane przez urządzenie biometryczne). W innych przypadkach częstotliwość próbkowania używana przez platformę może być niezależna od szybkości, z jaką odbierane są dane (np. Częstotliwość stała, częstotliwość konfigurowalna itp.). Na przykład, jeśli urządzenie biometryczne jest skonfigurowane do dostarczania danych biometrycznych z szybkością sześćdziesięciu próbek na minutę (60 spm), platforma może nadal przechowywać dane z szybkością 30 spm. Innymi słowy, przy częstotliwości próbkowania 30 spm platforma będzie przechowywać pięć wartości po dziesięciu sekundach, przy czym pierwsza wartość będzie drugą wartością przesłaną przez urządzenie biometryczne, a druga wartością będzie czwartą wartością przesłaną przez urządzenie biometryczne, oraz wkrótce. Alternatywnie, jeżeli urządzenie biometryczne jest skonfigurowane do dostarczania danych biometrycznych tylko wtedy, gdy dane biometryczne ulegają zmianie, platforma może nadal przechowywać dane z szybkością 30 spm. W tym przypadku pierwsza wartość przechowywana przez platformę może być pierwszą wartością przesłaną przez urządzenie biometryczne, druga przechowywana wartość może być pierwszą wartością przesłaną przez urządzenie biometryczne, jeżeli w momencie przechowywania żadna nowa wartość nie została przesłana przez urządzenie biometryczne, trzecia przechowywana wartość może być drugą wartością przesyłaną przez urządzenie biometryczne, jeżeli w momencie przechowywania nowa wartość jest przesyłana przez urządzenie biometryczne i tak dalej.

Po zapisaniu i połączeniu danych wideo i biometrycznych można użyć algorytmów do wspólnego wyświetlania danych. Na przykład, jeśli dane biometryczne są przechowywane z częstotliwością próbkowania 30 spm, która może być stała lub konfigurowalna, algorytmy (np. 216) mogą być użyte do wyświetlenia pierwszej wartości biometrycznej (np. Poniżej danych wideo, nałożonych na wideo dane itp.) na początku klipu wideo, druga wartość biometryczna dwie sekundy później (dwie sekundy w klipie wideo), trzecia wartość biometryczna dwie sekundy później (cztery sekundy w klipie wideo) itd. W alternatywnych przykładach wykonania według niniejszego wynalazku dane inne niż wideo (np. dane biometryczne, dane samorealizacji itp.) mogą być przechowywane z wieloma znacznikami czasu (np. indywidualne znaczniki lub przesunięcia dla każdej przechowywanej wartości), które mogą być użyte razem z czasem rozpoczęcia synchronizacji danych innych niż wideo z danymi wideo.

Należy zauważyć, że chociaż platforma klienta może być skonfigurowana do działania autonomicznego (tj. Niezależnie od urządzenia sieciowego hosta 240), w jednym przykładzie wykonania niniejszego wynalazku pewne funkcje platformy klienta są wykonywane przez urządzenie sieciowe hosta 240, i może być wykonywane tylko wtedy, gdy urządzenie obliczeniowe 200 komunikuje się z głównym urządzeniem komputerowym 240. Taki przykład wykonania jest korzystny, ponieważ nie tylko przenosi pewne funkcje na główne urządzenie komputerowe 240, ale zapewnia, że te funkcje mogą być wykonywane tylko przez główne urządzenie komputerowe 240 (np. wymaganie od użytkownika subskrypcji usługi chmury w celu wykonania określonych funkcji). Funkcje przenoszone do chmury mogą obejmować funkcje niezbędne do wyświetlania danych innych niż wideo razem z danymi wideo (np. Łączenie informacji z danymi wideo, łączenie informacji z danymi innymi niż wideo, synchronizacja danych innych niż wideo z danymi wideo itp.) lub może obejmować bardziej zaawansowane funkcje, takie jak generowanie i / lub udostępnianie „nagrania z najważniejszymi informacjami”. W alternatywnych przykładach wykonania urządzenie obliczeniowe 200 jest skonfigurowane do wykonywania powyższych funkcji, o ile spełnione są określone kryteria. Kryteria te mogą obejmować urządzenie obliczeniowe 200 komunikujące się z głównym urządzeniem komputerowym 240 lub urządzenie obliczeniowe 200, które poprzednio komunikowało się z głównym urządzeniem obliczeniowym 240, oraz okres czasu od ostatniej komunikacji równy lub krótszy od z góry określonego Ilość czasu. Technologia znana specjalistom w tej dziedzinie (np. Wykorzystująca kod uwierzytelniania metody oparty na skrócie (HMAC) z kluczem, przechowywany czas ostatniej komunikacji (umożliwiając wymienionemu urządzeniu obliczającemu określenie, czy wspomniana delta jest mniejsza niż z góry określona ilość czasu) itp.) mogą służyć do zapewnienia spełnienia tych kryteriów przed zezwoleniem na wykonywanie określonych funkcji.

Schematy blokowe przykładowego urządzenia komputerowego i przykładowego urządzenia biometrycznego przedstawiono na FIG. 5. W szczególności przykładowe urządzenie biometryczne 500 zawiera czujnik do wykrywania danych biometrycznych, wyświetlacz do łączenia się z użytkownikiem i wyświetlania różnych informacji (np. Danych biometrycznych, danych konfiguracyjnych, danych operacyjnych, takich jak start, stop i pauza itp.), pamięć do przechowywania wykrytych danych biometrycznych, nadajnik-odbiornik do komunikacji z przykładowym urządzeniem komputerowym 600 oraz procesor do obsługi i / lub sterowania transiwerem, pamięcią, czujnikiem i wyświetlaczem. Przykładowe urządzenie obliczeniowe 600 zawiera nadajnik-odbiornik (1) do odbierania danych biometrycznych z przykładowego urządzenia biometrycznego 500 (np. Przy użyciu dowolnego z telemetrii, dowolnego standardu WiFi, DNLA, Apple AirPlay, Bluetooth, komunikacji bliskiego zasięgu (NFC), RFID, ZigBee , Z-Wave, Thread, Cellular, połączenie przewodowe, podczerwień lub inny sposób transmisji danych, datacasting lub streaming, itp.), Pamięć do przechowywania danych biometrycznych, wyświetlacz do komunikacji z użytkownikiem i wyświetlania różnych informacji (np. , dane biometryczne, dane konfiguracyjne, dane operacyjne, takie jak start, stop i pauza, wprowadzanie komentarzy w trakcie sesji lub dodawanie notatek głosowych itp.), klawiatura do odbioru danych wejściowych użytkownika, nadajnik-odbiornik (2) do zapewnienia dane biometryczne do urządzenia obliczeniowego hosta przez Internet (np. przy użyciu dowolnego z telemetrii, dowolnego standardu WiFi, DNLA, Apple AirPlay, Bluetooth, komunikacji bliskiego pola (NFC), RFID, ZigBee, Z-Wave, Thread, Cellular, a połączenie przewodowe, podczerwień lub inna metoda transmisji danych, dan degustacja lub przesyłanie strumieniowe, itp.) oraz procesor do obsługi i / lub sterowania transiwerem (1), transiwerem (2), klawiaturą, wyświetlaczem i pamięcią.

Klawiatura w urządzeniu obliczeniowym 600 lub alternatywnie klawiatura w urządzeniu biometrycznym 500 może być wykorzystywana do wprowadzania danych samorealizacji lub danych dotyczących tego, jak użytkownik czuje się w określonym czasie. Na przykład, jeśli użytkownik czuje się zmęczony, może nacisnąć przycisk „T” na klawiaturze. Jeśli użytkownik czuje, że zaczynają działać ich endorfiny, może nacisnąć przycisk „E” na klawiaturze. A jeśli użytkownik łapie drugi oddech, może nacisnąć przycisk „S” na klawiaturze. Dane te są następnie przechowywane i łączone z częstotliwością próbkowania (np. Danymi biometrycznymi) lub danymi znacznika czasu, które mogą być godziną lub przesunięciem względem czasu rozpoczęcia naciśnięcia każdego przycisku. Pozwoliłoby to na synchronizację danych samorealizacji, w taki sam sposób jak danych biometrycznych, z danymi wideo. Pozwoliłoby to również na przeszukiwanie lub filtrowanie danych samorealizacji, takich jak dane biometryczne (np. W celu znalezienia wideo odpowiadającego danemu wydarzeniu, na przykład gdy użytkownik poczuł się zmęczony itp.).

Należy zauważyć, że niniejszy wynalazek nie ogranicza się do schematów blokowych pokazanych na FIG. 5, a urządzenie biometryczne i / lub urządzenie komputerowe, które zawiera mniej lub więcej komponentów, jest objęte duchem i zakresem niniejszego wynalazku. Na przykład urządzenie biometryczne, które nie zawiera wyświetlacza lub zawiera kamerę i / lub mikrofon, jest objęte duchem i zakresem niniejszego wynalazku, podobnie jak inne urządzenia do wprowadzania danych lub metody poza klawiaturą, takie jak ekran dotykowy. , pióro cyfrowe, urządzenie do rozpoznawania głosu / dźwięku, urządzenie do rozpoznawania gestów, tak zwane „urządzenie do noszenia” lub dowolne inne urządzenie rozpoznające, ogólnie znane specjalistom w tej dziedzinie. Podobnie, urządzenie komputerowe, które zawiera tylko jeden nadajnik-odbiornik, zawiera ponadto kamerę (do przechwytywania wideo) i / lub mikrofon (do przechwytywania dźwięku lub do wykonywania analiz przestrzennych poprzez rejestrowanie lub pomiar dźwięku i jego przemieszczania), lub ponadto zawiera czujnik (patrz fig. 4) mieści się w duchu i zakresie niniejszego wynalazku. Należy również zauważyć, że dane samorealizacji nie są ograniczone do tego, jak się czuje użytkownik, ale mogą również obejmować zdarzenie, które użytkownik lub aplikacja pragnie zapamiętać. Na przykład, użytkownik może chcieć zarejestrować (lub oznaczyć datą) użytkownika jadącego rowerem obok dzikiej przyrody lub określonej struktury architektonicznej, albo aplikacja może chcieć zarejestrować (lub oznaczenie czasu) pacjenta naciskając przycisk „poproś pielęgniarkę”, lub jakakolwiek inna wykrywana nie biometryczna aktywność użytkownika.

Odnosząc się do FIG. 1, jak omówiono powyżej w połączeniu z FIG. 2B, aplikacja główna (lub platforma klienta) może działać na urządzeniu obliczeniowym 108. W tym przykładzie wykonania, urządzenie obliczeniowe 108 (np. Smartfon) może być skonfigurowane do odbierania danych biometrycznych z urządzenia biometrycznego 110 (albo w rzeczywistości czas lub na późniejszym etapie ze znacznikiem czasu odpowiadającym wystąpieniu danych biometrycznych) oraz synchronizację danych biometrycznych z danymi wideo i / lub danymi audio zapisanymi przez urządzenie obliczeniowe 108 (lub kamerę i / lub mikrofon na nim działający). Należy zauważyć, że w tym przykładzie wykonania niniejszego wynalazku, poza aplikacją główną uruchamianą lokalnie (np. Na urządzeniu obliczeniowym 108), aplikacja hosta (lub platforma klienta) działa tak, jak omówiono wcześniej.

Ponownie, w odniesieniu do FIG. 1, w innym przykładzie wykonania niniejszego wynalazku urządzenie obliczeniowe 108 zawiera ponadto czujnik do wykrywania danych biometrycznych. W tym przykładzie wykonania niniejszego wynalazku aplikacja hosta (lub platforma klienta) działa jak omówiono wcześniej (lokalnie na urządzeniu obliczeniowym 108) i działa co najmniej w celu synchronizacji danych wideo, audio i / lub biometrycznych oraz umożliwia dane do odtworzenia lub zaprezentowania użytkownikowi (np. za pośrednictwem części wyświetlającej, urządzenia wyświetlającego podłączonego bezpośrednio do urządzenia obliczeniowego, za pośrednictwem urządzenia komputerowego użytkownika podłączonego do urządzenia obliczeniowego (np. bezpośrednio, przez sieć itp.) itp.).

Należy zauważyć, że niniejszy wynalazek, w jakimkolwiek przykładzie wykonania, nie jest ograniczony do urządzeń komputerowych (liczba lub typ) pokazanych na FIG. 1 i 2 i może obejmować dowolne urządzenie obliczeniowe, wykrywające, rejestrujące cyfrowe, GPS lub w inny sposób umożliwiające lokalizację (na przykład za pomocą systemów pozycjonowania WiFi „WPS” lub innych form określania położenia geograficznego, np. Poprzez triangulację sieci) , ogólnie znane specjalistom w tej dziedzinie, takie jak komputer osobisty, serwer, laptop, tablet, smartfon, telefon komórkowy, inteligentny zegarek, opaska do ćwiczeń, pasek do pomiaru tętna, czujnik materaca , czujnik podeszwy buta, aparat cyfrowy, czujnik pola bliskiego lub urządzenie wykrywające, itp. Należy również zauważyć, że niniejszy wynalazek nie jest ograniczony do żadnego konkretnego urządzenia biometrycznego i obejmuje urządzenia biometryczne, które są skonfigurowane do noszenia na nadgarstek (np. jak zegarek), noszony na skórze (np. jak plaster na skórze) lub na skórze głowy lub wbudowany w urządzenia komputerowe (np. smartfony itp.), albo zintegrowane z przedmiotami takimi jak pościel lub dodane do nich , urządzenia do noszenia, takie jak odzież, obuwie, kaski lub czapki lub ochrona słuchu lub sprzęt sportowy, taki jak rakiety, kije golfowe lub rowery, w przypadku których inne rodzaje danych, w tym wskaźniki wydajności fizycznej, takie jak prędkość rakiety lub główki kija, lub rotacja pedału / sekunda, lub obuwie, takie jak strefy uderzenia, chód lub ścinanie, można również mierzyć synchronicznie za pomocą danych biometrycznych i synchronizować z wideo. Inne dane mogą być również mierzone synchronicznie z danymi wideo, w tym biometrycznymi danymi zwierząt (np. Przyspieszenie byka, obrót lub koziołek podczas imprezy jeździeckiej, przyspieszenie konia dopasowane do tętna w wyścigu konnym itp.) Oraz wydolność fizyczna metryki obiektów nieożywionych, takie jak obroty / minutę (np. w pojeździe, takim jak samochód, motocykl itp.), mile / godzinę (lub tym podobne) (np. w pojeździe, takim jak samochód, motocykl itp., rower itp.) lub siły przeciążenia (np. doświadczane przez użytkownika, zwierzę, przedmiot nieożywiony itp.). Wszystkie te dane (łącznie „dane inne niż wideo”, które mogą obejmować metadane lub dane dotyczące danych innych niż wideo) mogą być synchronizowane z danymi wideo przy użyciu częstotliwości próbkowania i / lub co najmniej jednego znacznika czasu, jak omówiono powyżej.

Należy ponadto zauważyć, że niniejszy wynalazek nie musi działać w połączeniu z siecią, taką jak Internet. Na przykład, jak pokazano na FIG. 2A, urządzenie biometryczne 110, które może być, na przykład, pasmem aktywności bezprzewodowej do wykrywania tętna, oraz urządzenie obliczeniowe 108, którym może być na przykład cyfrowy rejestrator wideo, może być podłączone bezpośrednio do komputera głównego. urządzenie 106 z uruchomioną aplikacją hosta (niepokazane), gdzie aplikacja hosta działa jak omówiono wcześniej. W tym przykładzie wykonania dane wideo, audio i / lub biometryczne mogą być dostarczane do aplikacji hosta albo (i) w czasie rzeczywistym, albo (ii) w późniejszym czasie, ponieważ dane są zsynchronizowane z częstotliwością próbkowania i / lub znak czasu. Pozwoliłoby to na przykład pokazać przynajmniej film przedstawiający sportowca, sportowca lub kobietę (np. Piłkarz, piłkarz, kierowca wyścigowy itp.) W akcji (np. Podczas gry w piłkę nożną, gry w piłkę nożną) , wyścigi samochodowe itp.) wraz z danymi biometrycznymi sportowca w akcji (patrz np. RYS. 7). Tylko tytułem przykładu, pozwoliłoby to użytkownikowi zobaczyć tętno 730 piłkarza, gdy piłkarz kozłuje piłkę, kopie piłkę, kieruje piłkę głową itp. Można to osiągnąć za pomocą znacznika czasu 720 (np. czas itp.) lub inną metodę sekwencjonowania wykorzystującą metadane (np. częstotliwość próbkowania itp.), aby zsynchronizować dane wideo 710 z danymi biometrycznymi 730, umożliwiając użytkownikowi oglądanie piłkarza w określonym czasie 740 (np. 76 sekund) i dane biometryczne związane z sportowcem w tym konkretnym czasie 340 (np. 76 sekund). Podobną technologię można wykorzystać do wyświetlania danych biometrycznych innych sportowców, graczy w karty, aktorów, zbieraczy online itp.

Gdy pożądane jest monitorowanie lub oglądanie więcej niż jednej osoby z perspektywy kamery, na przykład pacjentów na oddziale szpitalnym obserwowanych z odległej stacji pielęgniarskiej lub podczas transmisji telewizyjnej z wydarzenia sportowego, takiego jak mecz piłki nożnej, z wieloma graczy na boisku, system może być tak skonfigurowany przez badanych za pomocą Bluetooth lub innych czujników do noszenia lub NFC (w niektórych przypadkach z możliwością wykrywania również lokalizacji w celu zidentyfikowania konkretnej osoby do śledzenia) zdolnego do transmisji ich dane biometryczne na wykonalnych odległościach, w połączeniu z przekaźnikami lub lampami ostrzegawczymi, jeśli to konieczne, tak, że widz może przełączać wybór danych biometrycznych jednej lub wielu osób do śledzenia, obok wideo lub transmisji, a jeśli chce i jeśli to możliwe, w ramach ograniczenia pola przechwytywania wideo stosowanej kamery, także w celu skoncentrowania widoku kamery wideo na ograniczonej grupie lub na określonej osobie. W alternatywnym przykładzie wykonania niniejszego wynalazku wybór danych biometrycznych jest wykonywany automatycznie, na przykład w oparciu o lokalizację osoby w klatce wideo (np. Środek kadru), szybkość ruchu (np. Poruszanie się szybciej niż inne osoby) lub bliskość czujnika (np. noszenie go przez osobę fizyczną, osadzenie w piłce noszonej przez osobę itp.), który może być wcześniej aktywowany lub aktywowany przez zdalny sygnał radiowy. Aktywacja czujnika może skutkować przesłaniem danych biometrycznych osoby do odbiornika lub może umożliwić odbiornikowi zidentyfikowanie danych biometrycznych osoby spośród innych przesyłanych danych (np. Danych biometrycznych od innych osób).

W kontekście śledzenia kondycji lub sportu należy wziąć pod uwagę, że przechwytywanie aktywności danej osoby na wideo nie jest zależne od obecności osoby trzeciej, która to robi, ale można sobie wyobrazić różne metody filmowania własnego, takie jak urządzenie do przechwytywania wideo zamontowane na nadgarstku lub uprzęży osoby lub na uchwycie do selfie, gimbalu lub przymocowane do przedmiotu (np. sprzętu sportowego, takiego jak kierownica roweru, przedmiotów znalezionych w środowiskach sportowych, takich jak koszykówka lub siatka do tenisa, słupek do bramki piłkarskiej, sufit itp., dronowy aparat śledzący osobę, statyw itp.). Należy ponadto zauważyć, że takie urządzenia do przechwytywania wideo mogą zawierać więcej niż jeden obiektyw aparatu, tak że można nagrywać nie tylko aktywność osoby, ale także jednocześnie inny widok, taki jak to, co osoba ogląda lub widzi przed sobą ( tj. otoczenie użytkownika). Urządzenie do przechwytywania wideo może być również wyposażone w wypukły obiektyw lustrzany lub może mieć wypukłe lustro dodane jako mocowanie z przodu obiektywu lub być pełną kamerą 360 stopni lub wieloma kamerami 360 połączonymi razem, tak że albo bez użycia wyspecjalizowanego oprogramowania znanego w tej dziedzinie można wygenerować widok dookoła lub dookoła 360 stopni lub widok ogólny 360 we wszystkich osiach.

W kontekście rzeczywistości rozszerzonej lub wirtualnej, gdy osoba nosi odpowiednio wyposażone okulary do rzeczywistości rozszerzonej („AR”) lub rzeczywistości wirtualnej („VR”), gogle, zestaw słuchawkowy lub jest wyposażona w inny rodzaj wyświetlacza umożliwiającego renderowanie AR, VR lub inne zsyntetyzowane lub rzeczywiste obrazy 3D, dane biometryczne, takie jak tętno z czujnika, wraz z innymi danymi, takimi jak na przykład przebieg treningu lub prędkość, z odpowiednio wyposażonego czujnika, takiego jak akcelerometr zdolny do mierzący ruch i prędkość, może być widoczny dla osoby, nałożony na jej pole widzenia. Dodatkowo awatar osoby w ruchu może być nałożony przed polem widzenia tej osoby, tak aby mogła ona monitorować lub poprawiać swoje wyniki ćwiczeń lub w inny sposób poprawiać wrażenia z czynności, oglądając siebie lub swój własny awatar, razem (np. zsynchronizowane) z ich wydajnością (np. dane biometryczne itp.). Opcjonalnie dane biometryczne również ich awatara lub awatara konkurującego mogą być jednocześnie wyświetlane w polu podglądu. Dodatkowo (lub alternatywnie) co najmniej jeden dodatkowy awatar szkoleniowy lub rywalizujący może być nałożony na widok osoby, co może pokazywać konkurujące awatary w odniesieniu do osoby (np. Pokazując je nałożone przed osobą, pokazując są nałożone na bok użytkownika, pokazując je za osobą (np. w części wyświetlacza będącej lusterkiem wstecznym itp.) i / lub pokazując je w odniesieniu do osoby (np. jako znaczniki na część wyświetlacza z ekranem radarowym itp.), itp. Rywalizujące awatary, składające się z prawdziwych ludzi, takich jak przyjaciele lub znajomi ze szkolenia, mogą być wykorzystywane do motywowania użytkownika do poprawy lub skorygowania ich wyników i / lub do ich program ćwiczeń jest bardziej interesujący (np. poprzez umożliwienie jednostce „konkurowania” w środowisku AR, VR lub Mixed Reality („MR”) podczas ćwiczeń lub treningu, lub wirtualne „grywalizacja” ich aktywności poprzez wizualizację wirtualnych miejsc docelowych lub lokalizacje, wyobrażone lub rzeczywiste, takich jak miejsca historyczne, zeskanowane lub utworzone syntetycznie za pomocą modelowania komputerowego).

Ponadto wszelkie źródła multimedialne, na które narażony jest użytkownik podczas wykonywania śledzonej i rejestrowanej czynności, powinny podobnie móc być rejestrowane ze znacznikiem czasu w celu analizy i / lub korelacji biometrycznej odpowiedzi danej osoby. Przykładem takiego zastosowania może być wybór konkretnych utworów muzycznych na wypadek, gdyby ktoś wykonywał ćwiczenie, gdzie korelacja wcześniejszych reakcji danej osoby, na przykład na podstawie tętna (i tego, jak dobrze osiągnął określony poziom). poziomy wykonania lub cele) do rodzaju muzyki (np. konkretny utwór muzyczny, utwór podobny do konkretnego utworu, utwór polecany lub wybrany przez innych, którzy słuchali lub polubili ten utwór) określone ścieżki itp.) są wykorzystywane do opracowania spersonalizowanego algorytmu w celu optymalizacji automatycznego doboru muzyki w celu zwiększenia wysiłku fizycznego lub maksymalizacji regeneracji w trakcie i po wysiłku. Osoba może ponadto określić, że życzyłaby sobie, aby określony utwór lub rodzaj muzyki, w oparciu o spersonalizowany algorytm wyboru, był odtwarzany w oparciu o ich położenie geograficzne; przykładem może być osoba, która często lub regularnie korzysta z określonego obwodu do celów treningowych lub rekreacyjnych. Alternatywnie, ścieżki lub rodzaje muzyki można wybrać poprzez nagranie lub korelację wcześniejszej odpowiedzi biometrycznej w połączeniu z wprowadzaniem samorealizacji, kiedy słuchano poszczególnych utworów.